Điểm sách: Nghĩ nhanh, nghĩ chậm

Trong một thời gian dài, các học giả đã gieo vào chúng ta một quan điểm là chúng ta – con người – như là những người đầy lí trí, quyết định một cách có tính toán cẩn thận. Nhưng Daniel Kahneman và đồng nghiệp của ông là Amos Tversky chứng minh rằng quan điểm đó sai. Trong cuộc sống hàng ngày, kể cả đời sống kinh tế, chúng ta thường đi đến những quyết định một cách thiếu nhất quán, cảm tính, và chủ quan. Bằng một văn phong đơn giản và dí dỏm, Gs Daniel Kahneman dìu dắt chúng ta qua những thí nghiệm mà ông và đồng nghiệp Amos Tversky đã thực hiện từ thập niên 1970, và kết quả của những thí nghiệm đó được tích tụ thành một cuốn sách rất uyên bác, nhưng cũng rất dễ hiểu và giải trí.

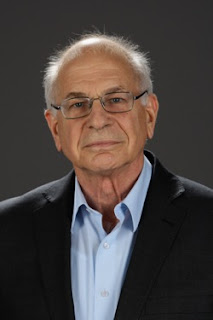

|

| GS. Daniel Kahneman |

Daniel Kahneman là người gốc Do Thái, ông tốt nghiệp tâm lí học từ Đại học Jerusalem (1954), và phục vụ trong quân đội Do Thái như là một chuyên gia tâm lí. Năm 1958 ông sang Mĩ học và tốt nghiệp tiến sĩ tâm lí học từ Đại học California, Berkeley (1958). Hiện nay ông là giáo sư tâm lí học thuộc Đại học Princeton. Năm 2002, ông được trao giải thưởng Nobel về kinh tế vì những phát kiến về lí thuyết viễn cảnh (Prospect Theory). Ông được xem là một nhà tâm lí học vĩ đại nhất trên thế giới còn sống.

Trong tác phẩm Nghĩ nhanh và nghĩ chậm, Kahneman mô tả hai cách thức (hay nói đúng hơn là hai hệ thống) mà não chúng ta vận hành. Ông gọi đó là hệ thống 1 và hệ thống 2. Hệ thống 1, còn gọi là cơ chế nghĩ nhanh, tự động, thường xuyên được sử dụng, cảm tính, rập khuôn, và tiềm thức. Hệ thống 2, còn gọi là cơ chế nghĩ chậm, đòi hỏi nỗ lực, ít được sử dụng, dùng logic, có tính toán, và ý thức.Trong một loạt thí nghiệm tâm lí mang tính tiền phong, Kahneman và Tversky chứng minh rằng con người chúng ta thường đi đến quyết định theo cơ chế nghĩ nhanh hơn là nghĩ chậm. Phần lớn nội dung của cuốn sách chỉ để chỉ ra những sai lầm trong hệ thống 1. Kahneman chứng minh rằng chúng ta tệ hơn những gì chúng ta tưởng: đó là chúng ta không biết những gì chúng ta không biết!

|

| Amos Tversky |

Suy nghĩ nhanh, theo cách nói ví von của người Việt chúng ta, là trông mặt mà bắt hình dong. Tức là một cơ chế suy nghĩ dựa vào những tín hiệu sơ khởi, thay vì tính toán cẩn thận và suy đoán dựa vào logic. Có thể liên tưởng về cơ chế suy nghĩ nhanh qua vài ví dụ cụ thể. Khi lái xe gắn máy trên đường đến một ngã tư, chúng ta có khi chỉ cần nhìn vào ánh mắt người lái xe đối diện để quyết định băng qua đường hay không. Trước thông tin rằng tỉ lệ mắc bệnh ung thư cao hơn ở vùng nông thôn hơn vùng thành thị, chúng ta có thể nghĩ ngay rằng vì dịch vụ y tế ở vùng nông thôn còn kém hơn vùng thành thị. Nhưng nếu có thông tin cho rằng ung thư vùng nông thôn thấp hơn vùng thành thị, có lẽ chúng ta nghĩ rằng cư dân nông thôn không sống trong môi trường ô nhiễm như cư dân thành thị, nên cư dân nông thôn có nguy cơ ung thư thấp hơn thành thị. Chính cơ chế suy nghĩ nhanh này giúp cho con người tồn tại qua hàng triệu năm, dù trong thực tế cũng sai lầm rất nhiều.

Những sai lầm trong cơ chế 1 được "chứng minh" qua hàng loạt thí nghiệm rất nổi tiếng. Có lẽ thí nghiệm nổi tiếng nhất là Vấn đề Linda. Trong thí nghiệm này, các đối tượng tham gia nghiên cứu được cung cấp thông tin về một phụ nữ tên là Linda (chỉ là nhân vật hư cấu), 31 tuổi, độc thân, tính tình thẳng thắn, rất thông minh, và thời còn là sinh triết, cô thường hay quan tâm đến những vấn đề kì thị chủng tộc và bất bình đẳng xã hội. Những người tham gia nghiên cứu được hỏi rằng Linda là:

(a) một nhân viên phục vụ khách hàng ở ngân hàng (bank teller); hay

(b) là một bank teller và đấu tranh cho nữ quyền (feminist).

Phần lớn (85%) người tham gia nghiên cứu chọn câu trả lời (b) là khả năng cao nhất. Nhưng câu trả lời đó vi phạm qui luật xác suất. Kahneman và Tversky gọi sai lầm này là nghịch lí liên hợp (Conjunction fallacy).

Nghịch lí tỉ suất nền (base rate fallacy).

Trong một thí nghiệm khác, Kahneman và Tversky cho một nhóm bác sĩ có kinh nghiệm trên 15 năm về một vấn đề rất đơn giản như sau. Trong một cộng đồng có 1% nữ bị bệnh ung thư. Các nhà khoa học có một phương pháp xét nghiệm rất chính xác để phát hiện ung thư. Với phương pháp này đối với những người mắc bệnh, xét nghiệm sẽ cho ra kết quả dương tính 95%; đối với những người không mắc bệnh, xét nghiệm sẽ cho ra kết quả âm tính 80%. Nếu một phụ nữ trong cộng đồng đó đi xét nghiệm và có kết quả dương tính, khả năng mà phụ nữ đó mắc bệnh ung thư là bao nhiêu? Đại đa số các bác sĩ cho rằng khả năng mắc bệnh là 90%. Nhưng trả lời đó sai. Sai là vì bác sĩ (hay chúng ta nói chung) lẫn lộn giữa xác suất mắc bệnh nếu kết quả dương tính với xác suất có kết quả dương tính nếu cá nhân mắc bệnh. Kahneman gọi đây là nghịch lí tỉ suất nền, và hệ quả là nhiều bệnh nhân bị chẩn đoán sai, vì bác sĩ dùng cơ chế suy nghĩ nhanh.

Trong một thí nghiệm nổi tiếng, Kahneman và Tversky cho các đối tượng chọn một trong 2 bao thư. Bao thư 1 có 200 USD một cách chắc chắn; và bao thư 2 đòi hỏi đối tượng phải tung một đồng xu, nếu mặt sấp xuất hiện thì được 400 USD, mặt ngửa thì không có đồng nào. Kết quả cho thấy phần lớn đối tượng tham gia nghiên cứu lựa chọn thứ nhất (dù hai lựa chọn này thật ra có giá trị kì vọng y chang nhau)! Kết quả này cho thấy chúng ta thích sự chắc chắn. Xu hướng này dẫn Kahneman và Tversky phát triển lí thuyết viễn cảnh, và là một công trình được trao giải Nobel kinh tế năm 2002.

Một thí nghiệm khác đặt đối tượng trong tình huống sau đây: một đại dịch sẽ giết chết 600 người nếu bạn không làm gì cả. Một vaccine đã được thử nghiệm sẽ có khả năng cứu 200 người một cách chắc chắn, nhưng sẽ thất bại cứu 400 người còn lại; hoặc dùng một vaccine chưa qua thử nghiệm có thể cứu sống 200 người và thất bại trong việc cứu 400 người khác. Kết quả thí nghiệm cho thấy 72% đối tượng chọn vaccine đã qua thử nghiệm.

Một thí nghiệm cực kì độc đáo cho thấy chúng ta rất dễ bị chi phối bởi con số lớn. Đối tượng nghiên cứu được đưa cho 2 lựa chọn: (a) với phẫu thuật A, 90% sống sót; (b) với phẫu thuật B, 10% tử vong. Phần lớn đối tượng chọn phẫu thuật A. Một thí nghiệm tương tự, mà theo đó một nhóm đối tượng được cho biết rằng xác suất mà họ mắc bệnh là 1 trên 10, một nhóm khác được cho biết xác suất mắc bệnh là 100 trên 1000. Kết quả cho thấy nhóm thứ hai có xu hướng chấp nhận điều trị hơn nhóm 1, dù nguy cơ mắc bệnh hai nhóm y chang nhau! Kahneman và Tversky gọi đó là hiệu ứng khung (framing effect).

Chúng ta thường đánh giá vấn đề qua tham khảo vào kinh nghiệm nổi bật vào thời điểm gần nhất, chứ không phải xem xét đến toàn bộ quá trình theo thời gian. Ví dụ như một nhận xét của Nhạc sĩ Đức Huy rằng người ca sĩ có thể bắt đầu bài hát không đạt, nhưng khi đoạn cuối bài hát được diễn tả thành công thì khán giả sẽ xem đó là một trình diễn thành công. Kahneman xem đây là điểm mà chúng ta rất giống … chuột.

Nếu một nhà khoa học rất giỏi về một lĩnh vực nào đó (như được trao giải Nobel y học), người ta thường giả định rằng nhà khoa học đó cũng am hiểu tất cả những vấn đề khác, dù nhà khoa học bản thân họ không nghĩ vậy. Điều này giải thích tại sao khi cần tranh thủ vận động một vấn đề xã hội nào đó, người ta thường tìm đến những ngôi sao điện ảnh, khoa học, thể thao, v.v. Kahneman gọi đó là hiệu ứng halo (halo effect) cũng là một cơ chế suy nghĩ theo hệ thống 1.

Cuốn sách hay công trình nghiên cứu của Kahneman có nhiều ý nghĩa cho những nhà hoạch định chính sách. Bài học là khi ra chính sách hay những qui định có ảnh hưởng đến nhiều người trong cộng đồng, cần phải vận dụng chứng cứ một cách cẩn thận, chứ không nên cảm tính và bồng bột (theo hệ thống suy nghĩ nhanh) vì dễ dẫn đến sai lầm.

Không chỉ có ý nghĩa cho các nhà hoạch định chính sách, cuốn sách còn có ích cho những người hành pháp. Ý nghĩa từ những hiệu ứng Linda, hiệu ứng khung, nghịch lí tỉ suất nền, v.v. là không thể và không nên trông mặt mà bắt hình dong, hay chỉ dựa vào tín hiệu bề ngoài mà đi đến kết án hay kì thị một cá nhân. Có trường hợp người ta lí giải rằng 60% những ca tội phạm thiếu niên là xuất phát từ những gia đình li dị hay đổ vỡ, và đi đến kết luận rằng li dị là một nguyên nhân hay nguồn gốc của tội phạm thiếu niên. Nhưng kết luận đó không logic và rất có thể sai. Đó cũng là một nguỵ biện rất phổ biến (prosecutor fallacy). Nguỵ biện xảy ra là vì người ta lười biếng suy nghĩ, và vì lười biếng suy nghĩ nên người ta chỉ sử dụng hệ thống 1 (mà không sử dụng hệ thống 2).

(*) "Thinking, fast and slow" (499 trang) của Daniel Kanehman, Nhà xuất bản Farrar, Straus, and Giroux, 2011. Sách có bán trên Amazon.com.

Nguyễn Văn Tuấn

Tags: book

3 Comments